A tecnologia de efeitos especiais teve um verdadeiro boom nas últimas décadas, com o CGI movendo-se de rudimentarmente bruto e primitivo para quase indistinguível da realidade. Agora, à medida que a criação de imagens verossimilhanças se torna cada vez mais comum, analistas políticos e especialistas em justiça criminal estão prevendo um pânico em torno da chamada tecnologia 'falsa profunda', que tem o potencial de complicar ainda mais uma discussão internacional em curso sobre 'notícias falsas'. Mas o que, exatamente, é uma 'farsa profunda' e quanta ameaça essa tecnologia representará no futuro?

A tecnologia deep fake (às vezes estilizada como 'deepfake') refere-se a imagens e / ou vídeos sintetizados e / ou sobrepostos criados por inteligência artificial usando imagens e vídeos existentes. Usando o aprendizado de máquina, essa tecnologia poderia teoricamente criar imagens convincentes de uma pessoa realizando um ato que nunca realmente ocorreu na vida real.

Owen Williams, um engenheiro de software profissional e artista de efeitos visuais, ofereceu uma explicação simples.

'É uma maneira de usar um sistema de software automatizado para substituir o rosto de uma pessoa em um vídeo por outro rosto que é muito mais automático e convincente do que era possível com a tecnologia anterior', disse Williams Oxygen.com .

Williams observou que filmes populares como 'Jurassic Park' e 'Blade Runner: The Final Cut' usavam software de computador para certas cenas de maneiras que poderiam ter sido um precursor de falsificações profundas: 'Na indústria cinematográfica, isso é muito comum. Digamos que você tenha um personagem que precisa fazer uma manobra e prefira que seu rosto fique visível. A solução clássica seria que você só os veria de costas, ou seus cabelos ficariam na cara, então você não poderia dizer que era um duplo. Mas há uma história bastante envolvente de cineastas usando computadores para colocar o rosto de um ator sobre o de um dublê.

“Costumava ser um processo muito manual”, continuou Williams. 'Agora, com a tecnologia falsa profunda, você alimenta um computador com duas coisas: primeiro o vídeo que você vai substituir e, em seguida, um monte de entradas do rosto que você vai substituir. Você tem que obter imagens suficientes de uma pessoa fazendo diferentes expressões faciais e de diferentes ângulos. Você está criando uma biblioteca de como o rosto dessa pessoa pode ficar em diferentes situações e, em seguida, o computador passa e vê o vídeo. Também não precisa de uma correspondência exata. Ele pode espremer e transformar o que está na biblioteca para se adequar ao que precisa. O que costumava exigir centenas de horas de dezenas de artistas para tentar executar um efeito realmente complicado, agora é apenas um toque de botão. '

Uma faceta dessa tecnologia que preocupa as pessoas é que uma pessoa não precisa necessariamente enviar voluntariamente seu rosto para que esse processo seja executado, considerando quantas fotos existem online da maioria das pessoas - especialmente celebridades e figuras políticas.

'Há fotos suficientes de qualquer celebridade em ângulos suficientes para que você possa criar essa biblioteca [sem consentimento]', disse Williams. “Há uma certa quantidade de trabalho necessário para fazer isso, mas para qualquer figura marginalmente popular, esse material vai existir. Minha sensação é que é menos provável que isso seja possível para uma pessoa normal. '

Os primeiros vídeos profundamente falsos apareceram nos fóruns do Reddit no final de 2017, de acordo com a variedade . Um usuário afirmou ter usado seu computador para criar vídeos pornográficos altamente realistas de várias celebridades envolvidas em atividades sexuais que nunca aconteceram na vida real. O usuário afirmou que alimentou seu computador com milhares de fotos das estrelas, das quais a IA poderia obter as expressões faciais e os movimentos descritos. Um aplicativo usado por profundos criadores falsos e compartilhado no Reddit foi baixado mais de 100.000 vezes. (Reddit acabaria por banir este tipo de conteúdo, dizendo que violava sua política de 'pornografia involuntária', de acordo com The Verge .)

O realismo que este meio pode alcançar no momento é questionado por Williams.

homem baleado 41 vezes pela polícia

'Se você já assistiu a uma dessas falsificações profundas ... há uma certa estranheza nisso', disse Williams. - Eles não são polidos. Provavelmente ficará cada vez melhor, especialmente porque Hollywood tem interesse em automatizar isso em vez de pagar artistas caros. '

Da mesma forma, Williams adivinhou que apesar o pânico em torno da pornografia falsa profunda , a mudança de atitudes culturais em torno da natureza de coisas como pornografia de vingança ou vazamento de imagens de nudez significa que é provável que as pessoas que criam esse tipo de mídia sejam condenadas e não celebradas, mesmo dentro da indústria de entretenimento adulto.

em que as colinas têm olhos

“Isso nunca vai ser popular”, teorizou Williams. 'Após ' The Fappening 'coisa aconteceu no Reddit, as pessoas foram capazes de mudar a conversa e dizer,' Isso não é um escândalo, é um crime sexual. ' Então, eu simplesmente não vejo isso se tornando um escândalo tanto quanto as pessoas pensam que será. As pessoas também podem encontrar facilmente o pornô original de onde a falsificação profunda foi criada, o que significa que é bastante fácil de desmascarar. '

Mas não está apenas causando preocupação porque pode ser usado para criar pornografia falsa com celebridades. As pessoas também estão preocupadas com as ramificações políticas.

Especialistas políticos começaram a escrever sobre a proliferação de falsificações profundas em 2018. Um artigo do Guardian a partir de novembro daquele ano, notou a disseminação viral de um vídeo supostamente retratando o presidente Donald Trump incentivando a nação belga a se retirar do Acordo Climático de Paris. Isso catalisou uma discussão mais ampla sobre o potencial de vários governos de usar essa tecnologia em campanhas de desinformação em massa, uma conversa que já havia sido iniciada graças à investigação em andamento sobre o envolvimento da Rússia nas eleições presidenciais de 2016 nos Estados Unidos.

O pânico em torno de falsificações profundas até inspirou o conselho editorial do Bloomberg Media Group a escrever um artigo de opinião com palavras fortes sobre o assunto.

'As evidências de vídeo se tornaram um pilar do sistema de justiça criminal ... precisamente porque o filme parece ser um registro confiável da fala ou das ações de alguém. Falsificações profundas podem tornar essas evidências suspeitas, ' eles escreveram em junho de 2018. 'Um grande desafio, então, será identificar e denunciar essas falsificações - se isso for possível.'

Williams concordou que a natureza das falsificações profundas ameaçam nossas noções de 'realidade' no que diz respeito às evidências de vídeo, mas observou que esse atoleiro jurídico não é exclusivo de nosso cenário digital contemporâneo.

'Isso meio que se resume a essa ideia de que as pessoas têm aquele vídeo igual à verdade, o que nunca foi o caso. Sabíamos disso a partir de Rodney King. Ou, pense em Eric Garner : As pessoas pensaram que [o policial que o matou] era inocente, independentemente do vídeo do incidente previsto. Para mim [muitos dos medos em torno de falsificações profundas] parecem um tanto infundados. '

Williams listou vários outros incidentes que não envolveram tecnologia profundamente falsa, que mostraram as maneiras como o vídeo foi corajosamente manipulado para distorcer a opinião pública sobre um assunto, como A controvertida queda da ACORN por James O'Keefe e um escândalo recente envolvendo vídeo adulterado supostamente retratando o repórter da CNN Jim Acosta atacando um funcionário da Casa Branca .

A conclusão final de Williams foi que a histeria em torno das falsificações profundas é um tanto exagerada.

'O que vejo acontecendo é que funcionará nos dois sentidos. Se um vídeo for lançado e for real, as pessoas dirão que é falso. Se um vídeo for lançado e for falso, as pessoas dirão que é real. Cada caso assume uma certa quantidade de verdade atribuída ao vídeo [ele mesmo]. É difícil saber em que direção tudo isso vai. The Pee Tape realmente saiu, por exemplo, você sabe exatamente o que aconteceria: Metade das pessoas diria, 'Isso é touros - t, é algum ator!' e metade das pessoas diria: 'Aí está! É real!' Portanto, nada realmente mudaria. Isso tende a ser o que acontece com as novas tecnologias: as coisas não mudam tanto quanto as pessoas pensam. '

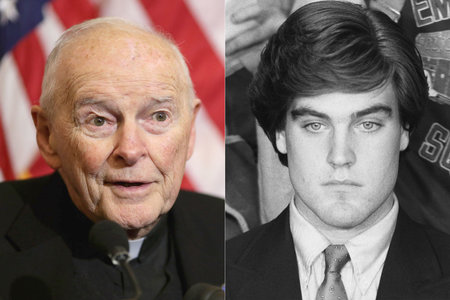

[Foto: SAUL LOEB / AFP / Getty Images]